Bewerbungsgespräch mit einem Angreifer

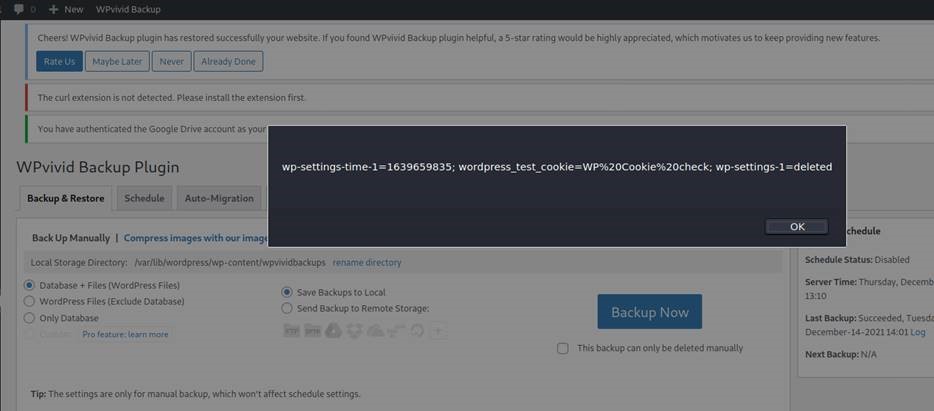

Das Sicherheitsunternehmen KnowB4 hat einen Fall öffentlich gemacht, bei dem sich ein neuer Mitarbeiter als nordkoreanischer Spion entpuppte. Enttarnt wurde er gleich am ersten Tag, nachdem er als Remote-Arbeiter zum ersten Mal seinen zugesandten Rechner startete und sofort eine Malware installieren wollte. Im Nachhinein fielen dann auch weitere Ungereimtheiten bei der Bewerbung auf, die das Sicherheitsunternehmen zur Warnung anderer Unternehmen in seinem Blog beschreibt.

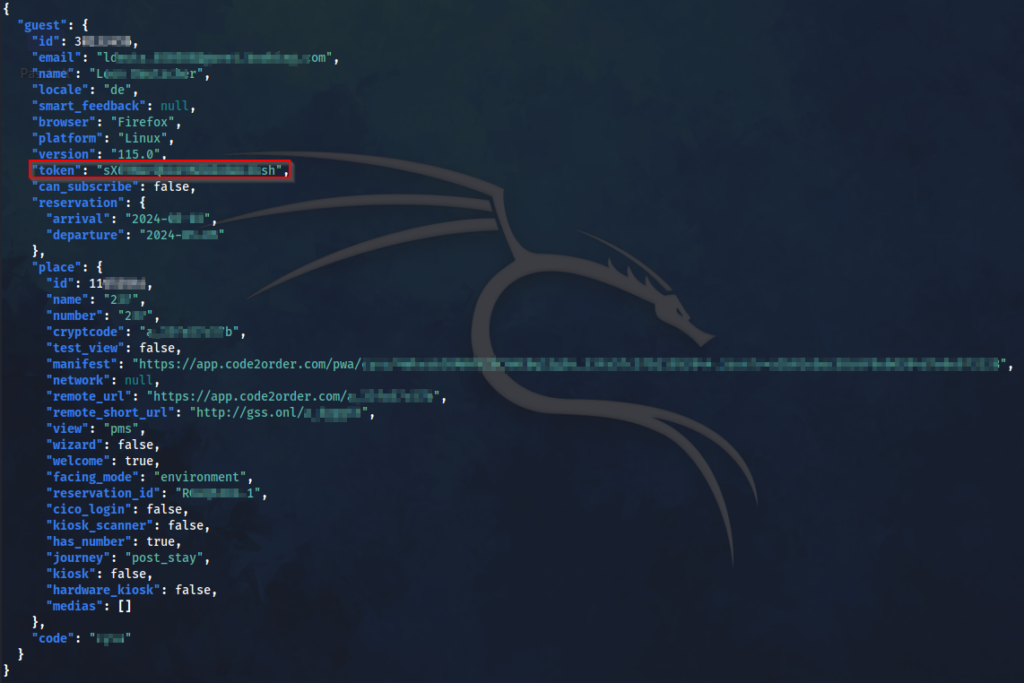

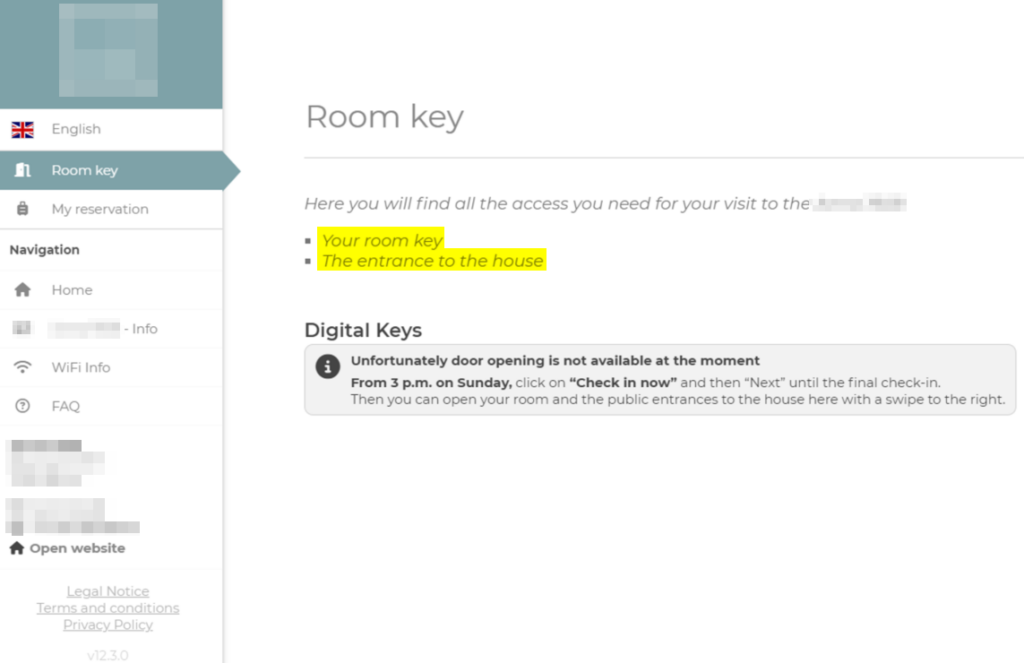

Im Juni hatte das Wall Street Journal bereits ausführlicher über diese Gefahr berichtet und verschiedene andere Betroffene zitiert. Genutzt werden dabei sogenannte Laptop-Farmen, die die Rechner der vermeintlichen Homeoffice-Arbeitenden einsammeln, zeitlich passend in Betrieb nehmen und mit einer Fernsteuerungslösung ausstatten, damit sich anschließend mehrere Personen die Aufgaben des vorgeblichen Mitarbeitenden teilen können und natürlich gleichzeitig ihre eigenen Ziele verfolgen.

Diese Angriffsart funktioniert “dank“ standardisierter Bewerbungsprozesse, die komplett remote ablaufen und der Tatsachen, dass auch zur Arbeitsaufnahme kein persönliches Treffen vorgesehen ist. Die vermeintlichen Mitarbeitenden existieren nur als KI-generierte Lebensläufe und als manipulierte Bilder.

Wenn Sie jetzt an Ihre Abläufe bei Bewerbungen und die ersten Wochen für neue Mitarbeitende denken: An welcher Stelle würde Ihnen ein Angriffsversuch dieser Art auffallen?

https://blog.knowbe4.com/how-a-north-korean-fake-it-worker-tried-to-infiltrate-us